Überblick über Bildsensoren und die Bildverarbeitung

Grundlagen der Bildaufnahme und -verarbeitung

Unter „industrieller Bildverarbeitung“ versteht man die softwaregestützte Bearbeitung von Bildern zum Zweck automatisierter Erkennung. Bildverarbeitung hat sich als Alternative zur Sichtprüfung in der automatisierten Prüfung bereits etabliert, da sie in vielen Fällen deutlich günstiger und präziser ist. Dieser Abschnitt stellt die Bildsensoren als Ausgangspunkt der Bildverarbeitung sowie die Grundlagen der Bildverarbeitung vor.

Bildsensor

Eine Digitalkamera ist ähnlich aufgebaut wie eine herkömmliche (analoge) Kamera. Der wesentliche Unterschied: Die Digitalkamera ist mit einem digitalen Bildempfangselement ausgerüstet, dem so genannten CCD (Charge Coupled Device = ladungsgekoppeltes Bauteil). Dem Bildempfangselement kommt die Rolle zu, die in einer herkömmlichen Kamera der Film erfüllt. Er erfasst Bilder, nun jedoch in Form von Digitaldaten. Doch wie erfolgt diese Umwandlung in Digitalsignale?

CCD-Bildempfangselement

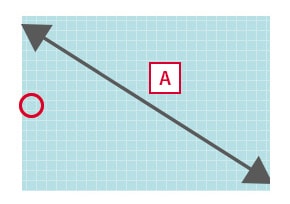

Das CCD (Charge Coupled Device) ist ein Halbleiterbauelement, das Bilder in Digitalsignale umzuwandeln vermag. Es weist oft eine Höhe und Breite von jeweils circa 1 cm auf und besteht aus zahlreichen kleinen Punkten, den so genannten Pixeln, die in einem Gitterverbund angeordnet sind.

Wenn Sie mit einer Digitalkamera ein Bild aufnehmen, gelangt das vom Messobjekt reflektierte Licht durch das Objektiv zum CCD-Bildempfangselement, auf dem es ein Abbild erzeugt. Wenn ein Pixel auf dem CCD-Element Licht empfängt, erzeugt es eine elektrische Ladung, die zur Lichtintensität proportional ist. Die elektrische Ladung wird in ein elektrisches Signal umgewandelt, um die Lichtintensität (Konzentrationswert) zu erhalten, die von jedem einzelnen Pixel empfangen wird.

1/1,8 Zoll(circa 9mm)

Jedes einzelne Pixel stellt quasi einen Sensor, ähnlich einer Fotodiode, dar, welcher Lichtintensität erkennen kann. Ein 2-Millionen-Pixel-CCD-Element ist praktisch nichts anderes als eine Anordnung von 2 Millionen Fotodioden.

Eine Fotodiode vermag das Vorhandensein/Fehlen eines Messobjekts einer gewissen Größe an einem bestimmten Ort zu bestimmen. Ein einzelner Sensor ist allerdings nicht wirkungsvoll, wenn es um komplexere Anwendungen geht, wie etwa die Erkennung von Messobjekten an unterschiedlichen Positionen, das Erkennen und Messen von Objekten mit unterschiedlichen Formen oder die Durchführung von umfassenden Positions- und Dimensionsmessungen. Ein CCD-Bildempfangselement mit Millionen von Sensoren ermöglicht dies jedoch und bietet daher eine enorme Ausweitung der Anwendungsmöglichkeiten, einschließlich der auf der ersten Seite angesprochenen vier Hauptanwendungsbereiche.

Verwendung der Pixeldaten für die Bildverarbeitung

Im letzten Abschnitt des vorliegenden Leitfadens soll kurz das Verfahren erläutert werden, mit dem durch jedes einzelne Pixel die Lichtintensität in verwertbare Daten umgewandelt und anschließend zur Verarbeitung an das Bildverarbeitungsystem weitergeleitet wird.

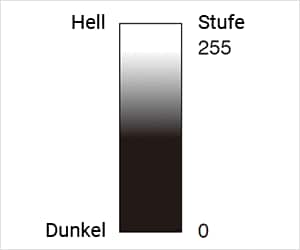

Daten der einzelnen Pixel (bei einer herkömmlichen Schwarz-Weiß-Kamera)

In der Regel übermittelt jedes Pixel eines CCD-Bildempfangselements entsprechend der Lichtintensität die Daten in 256 Stufen (8 Bit). Bei einer Schwarz-Weißen-Bildverarbeitung (monochrom) ist Schwarz der Wert „0“ zugewiesen und Weiß der Wert „255“. Auf diese Weise kann die von jedem einzelnen Pixel empfangene Lichtintensität in numerische Daten umgewandelt werden. Das bedeutet, dass jedes Pixel eines CCD-Elements einen Wert zwischen 0 (Schwarz) und 255 (Weiß) aufweist. So wird beispielsweise ein Grauwert, der zu genau den gleichen Teilen Weiß und Schwarz enthält, in den Wert „127“ umgewandelt.

Ein Bild ist eine Anordnung von Daten mit 256 Helligkeitsstufen

Ein CCD besteht aus vielen einzelnen Pixeln. Die von einem CCD erfassten Bilddaten sind eine Datenanordnung dieser Pixel, wobei jeder Pixel einen Helligkeitswert von 0 und 255 beisteuert.

-

Unbearbeitetes Bild

-

Wenn das unbearbeitete Bild mit 2.500 Pixeln dargestellt wird.

-

Der Bildausschnitt des Auges nunmehr vergrößert und mit Helligkeitsstufen von 0 bis 255 dargestellt.

Die Augenlinie weist einen Wert von 30 auf, was fast schwarz ist, und die Umgebung weist einen Wert von 90 auf, was heller als 30 ist.

Die Augenlinie weist einen Wert von 30 auf, was fast schwarz ist, und die Umgebung weist einen Wert von 90 auf, was heller als 30 ist.

Wie im Beispiel oben gezeigt, werden die Bilddaten Pixel für Pixel durch einen Wert zwischen 0 und 255 wiedergegeben. Bei der Bildverarbeitung werden in einem Bild Merkmale gefunden, indem die numerischen Daten pro Pixel mit einer Vielfalt von Berechnungsmethoden bearbeitet werden, wie unten gezeigt.

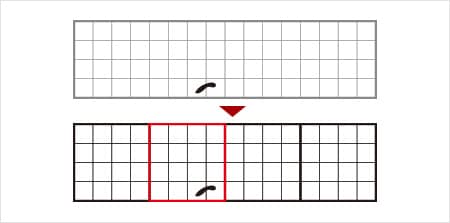

Beispiel: Flecken-/Mängelprüfung

Der Prüfbereich wird in kleine Bereiche, so genannte Segmente, unterteilt. Der Mittelwert der Intensitätsdaten (0 bis 255) im Segment wird mit dem entsprechenden Mittelwert für den umgebenden Bereich verglichen. Aufgrund dieses Vergleichs werden Stellen, deren Intensität um mehr als den vorgegebenen Wert abweicht, als Flecken oder Mängel/Defekte erkannt.

Der Mittelwert der Intensität eines Segments (4 Pixel x 4 Pixel) wird mit dem entsprechenden Mittelwert für den umgebenden Bereich verglichen. Im Beispiel oben werden im roten Segment Flecken erkannt.

Überblick über CCD und die Grundlagen der Bildverarbeitung

Bildverarbeitungssysteme können anhand der von den Pixeln eines CCD-Bildempfangselements gelieferten Intensitätsdaten mit 256 Helligkeitsstufen pro Pixel folgende Objektdaten erkennen: Flächen (Anzahl der Pixel), Positionen (Punkt der Intensitätsänderung) und Mängel (Änderung im Mittelwert der Intensität). Durch Auswahl von Systemen mit höherer Pixelauflösung und höherer Geschwindigkeit lässt sich die Anzahl an möglichen Anwendungen in jedem Industriebereich mühelos ausweiten.

Das Thema der nächsten Ausgabe behandelt die Grundlagen bei der Objektivauswahl. Da bei der Bildverarbeitung Änderungen von Intensitätsdaten durch Berechnungen ermittelt werden müssen, ist für eine stabile Erkennung die Erfassung eines klaren, scharfen Bildes unverzichtbar. In den nächsten Ausgaben erläutern wir, wie Objektive richtig ausgewählt sowie eingesetzt werden und welche Beleuchtungsmethoden erforderlich sind, um ein klares, scharfes Bild zu erzielen.

![Technikgeschichte Der Bildverarbeitung Band 1 [Kamera]](/img/asset/AS_63138_L.jpg)

![Die neuesten Anwendungsbeispiele aus der Bildverarbeitung [Automotive]](/img/asset/AS_72922_L.jpg)

![Die neuesten Prüfungen mithilfe Bildverarbeitung [Lebensmittelindustrie und Pharmaindustrie]](/img/asset/AS_73109_L.jpg)

![Die neuesten Prüfungen mithilfe Bildverarbeitung [Elektronikbauteile & Elektronikgeräte]](/img/asset/AS_87575_L.jpg)